近年来,L2级辅助驾驶技术在汽车行业内如火如荼地发展,然而,这一技术近期遭遇了前所未有的监管挑战。4月16日,工业和信息化部装备工业一司发布了一则公告,对汽车生产企业在辅助驾驶技术的宣传、使用及OTA升级等方面提出了严格要求。

公告指出,汽车企业需清晰界定辅助驾驶系统的功能边界和安全响应措施,严禁夸大和虚假宣传,确保履行告知义务,并对产品的生产一致性和质量安全负起主体责任,以提升智能网联汽车产品的安全水平。这一系列规定,无疑给正准备借上海车展大展拳脚的车企们泼了一盆冷水。多家车企的营销计划被迫调整,部分已拟定的宣传文案和OTA升级内容不得不重新审议。

那么,为何L2级辅助驾驶技术在“系统功能边界”和“安全响应措施”上存在模糊地带呢?这主要源于辅助驾驶技术的“拟人化”发展。随着端到端大模型的广泛应用,辅助驾驶系统开始通过大量案例训练,自主学习人类驾驶方式。这种转变使得辅助驾驶能力的进步更多地依赖于AI大模型的能力提升,而非传统的手写规则开发。

拟人化的驾驶体验,如平稳的加减速、从容处理紧急情况、以及令人信赖的跟车和超车能力,成为评价辅助驾驶系统的重要指标。然而,这些主观感受往往因环境而异,难以用统一规则描述。因此,辅助驾驶系统何时应退出并将驾驶权交还给人类,成为了一个棘手的问题。过早退出会影响用户体验和百公里接管次数这一关键指标,而过晚退出则可能带来安全隐患。

功能安全难题也是辅助驾驶技术发展面临的一大挑战。尽管国内汽车标准正在逐步完善,但针对L2级辅助驾驶的安全监管仍存在空白。特别是当端到端大模型成为主流技术方案后,传统的功能安全理念在这一框架下难以贯彻。大模型作为一个“黑盒”,使得车企在前期架构设计和功能定义阶段难以介入,无法提出具体的安全要求。

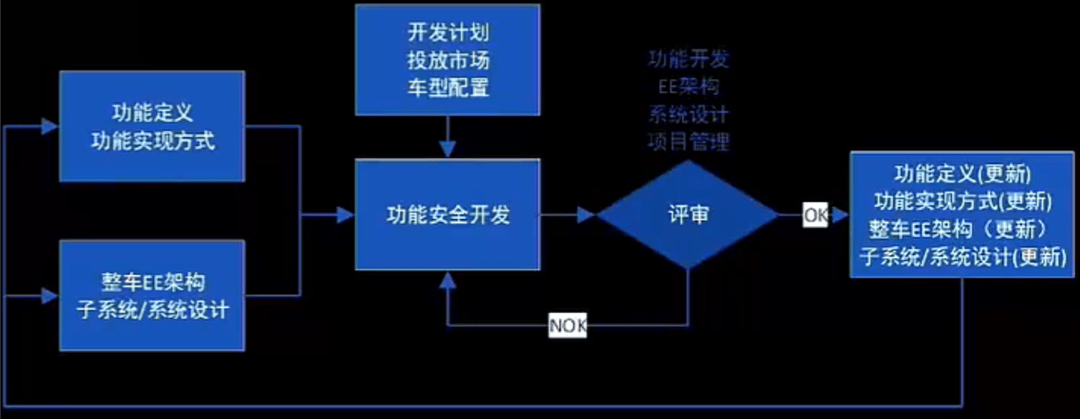

为了应对这一挑战,一些车企在功能安全方面做出了积极尝试。他们在新车开发的早期阶段便开始介入功能安全,确保在车型开发过程中同步跟进,并在功能变更时提出适应性变更要求。然而,即便如此,面对端到端大模型的“黑盒”特性,车企仍难以在整个流程中有效贯彻功能安全理念。

与此同时,现有的法规对智能驾驶技术的规定也相对模糊,使得车企在功能安全方面难以找到明确的执行标准。为了加强监管,工信部联合市场监管总局发布了相关征求意见稿,对车企的OTA升级进行了规范。然而,这些规定更多是从结果和影响出发,针对技术本身的标准仍不明确。

在此背景下,欧盟的《通用产品安全法规》提供了一种可能的解决思路。该法规要求企业在产品出现安全事故时提供充足证据,证明自己已尽到最优责任,否则将面临巨额罚款。这一规定促使企业在研发和生产过程中加强“自我审查”,建立高标准的安全体系。

尽管面临诸多挑战,但辅助驾驶技术的发展仍在继续。端到端大模型不仅提高了辅助驾驶系统的能力上限,还避免了传感器信息在模块间传递时的衰减,使得减少昂贵传感器的产品方案成为可能。这将有助于将辅助驾驶技术普及到更便宜的车型上。

然而,随着辅助驾驶技术的普及,规范技术的安全边界已迫在眉睫。为了加强监管,有关部门正在收紧对车企OTA升级的审查,要求降低OTA频次,并对单次OTA进行充分验证。同时,还规范了辅助驾驶技术的宣传和使用方式,禁止使用“自动驾驶”、“智驾”等名词,并敦促厂商从技术层面禁止驾驶员脱离驾驶辅助状态。

这一系列措施的实施,无疑将对辅助驾驶技术的发展产生深远影响。在加强监管的同时,也需要鼓励技术创新和产业升级,以实现辅助驾驶技术的安全、可靠和普及。