在科技界的聚光灯下,一场围绕人工智能大模型价格战的争论悄然上演,主角是百度智能云事业群总裁沈抖与火山引擎总裁谭待,两位均出身于百度,却在新的舞台上针锋相对。

事件的导火索是沈抖在百度智能云事业群(ACG)的一次内部会议上的发言。他严厉指出,去年国内大模型市场的“恶意”价格战,使得整个行业的收入水平与国外相比,存在着巨大的差距。此番言论,无疑将矛头指向了包括火山引擎、阿里云、腾讯云在内的多家参与价格战的企业。而沈抖更进一步,特别点名了字节跳动的AI产品豆包,认为其高昂的训练和投放成本,是导致行业恶性竞争的重要因素之一。

面对沈抖的指责,谭待在朋友圈迅速作出回应,直接反驳了“恶意”一词的使用。他强调,火山引擎的豆包1.5Pro模型,在预训练和推理成本上均低于百度的DeepSeek V3,更远低于国内其他模型,因此能够在当前价格下保持良好的盈利能力。谭待将这一切归功于技术进步,他指出,国内外厂商都在通过技术创新来降低模型价格,火山引擎只是做到了Gemini 2.0 Flash的价格水平,这是技术进步的自然结果。

谭待的回应并未止步于此,他还向老东家提出了建议,呼吁大家应像DeepSeek一样,专注于基本功和创新,避免无端猜测和归咎于外因。

这场争论的核心,聚焦于大模型的降价、商业化和DeepSeek的影响。沈抖认为,火山引擎等企业的行为,破坏了行业风气,将大模型卷入了价格战,进而影响了AI产品的健康发展。而谭待则坚决否认,他认为降价是火山引擎技术优势的体现,并暗示百度在大模型技术上存在不足,才会寻找外部理由。

事实上,去年的大模型价格战,几乎涉及了国内所有云厂商,百度也在其中。DeepSeek率先发起攻势,将大模型价格打入“厘时代”,随后,价格战在行业内全面爆发,百度更是宣布文心大模型两大主力模型免费使用,进一步加剧了竞争。

然而,沈抖所提到的国内大模型行业创收问题,确实是一个客观事实。与国外同行相比,国内大模型的收入差距显著。但问题的根源,并非仅仅在于价格。实际上,国内大模型在技术和应用场景上的差距,才是导致收入差异的关键因素。在模型能力尚未达到领先水平的情况下,国内大模型面临的是赔钱赚吆喝的困境,最终还是要依靠云服务来实现盈利。

从这个角度来看,百度云和火山引擎面临着相同的挑战,互相指责对于行业的健康发展并无益处。如果说存在“恶意”,那么豆包在投放上的排外性,或许更值得关注。豆包依靠字节的天然曝光优势,抑制了其他AI应用的投放,无形中阻碍了其他创业公司的成长。

不过,大模型卷“低价”并非全然消极。开源、普惠、技术平权,正成为未来的大趋势。DeepSeek作为一条“鲶鱼”,已经对闭源大模型体系发起了冲击,扭转了行业对开源的认知。OpenAI等国外巨头也开始调整策略,向用户开放更多功能,并计划开源部分模型规范。

在国内,百度也迅速调整方向,宣布文心一言将全面免费,并计划在未来几个月内推出文心大模型4.5系列,并于6月30日起正式开源。这一系列动作,无疑将推动大模型的普及和应用。

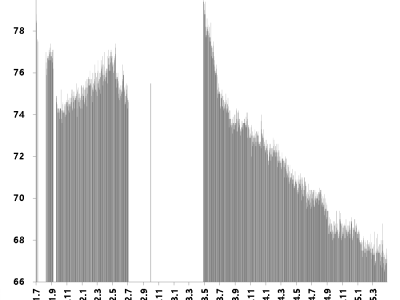

从技术发展曲线来看,大模型推理和AI成本将持续下降。这种竞争态势,将推动大模型效率的提升,为AI大模型的性价比大战火上浇油。

DeepSeek的崛起,也引发了行业的集体反思。沈抖认为,DeepSeek是科技发展的拐点,将推动开发生态的繁荣。而字节CEO梁汝波也在全员会上反思,面对DeepSeek带来的技术变化,字节未能及时跟进,错失了时机。

短期内,DeepSeek带来的流量红利,让云大厂受益匪浅。然而,在商业化方面,云厂商通过降价、免费政策所吸引的用户,并未转化为可观的收入。更为关键的是,随着更强性能模型的诞生,如何将推理能力与业务场景结合,成为下一步的发展方向。

目前,众多企业已经开始接入DeepSeek,央国企更是点名要求本地部署DeepSeek-R1,采购所适配的硬件和算力。这无疑给云厂商的大模型2B业务带来了新的挑战和机遇。