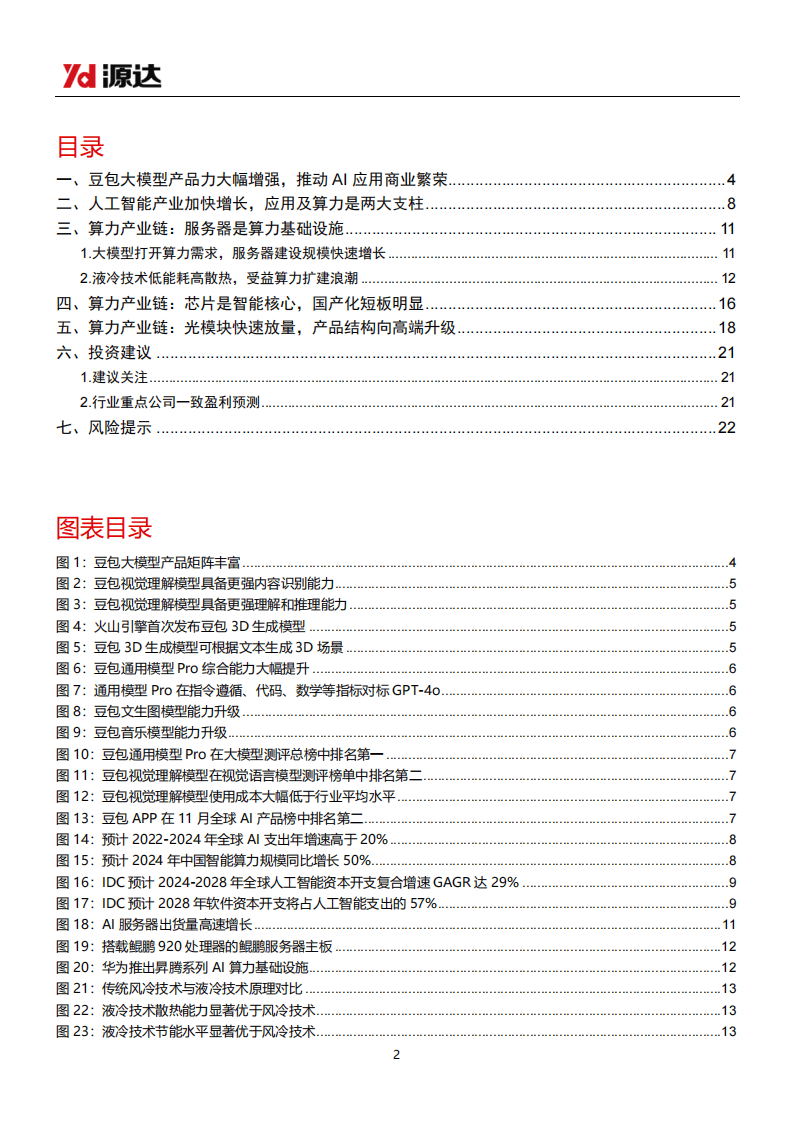

近期,人工智能领域迎来了一次重要的技术革新。火山引擎在2024年末推出的豆包视觉理解和3D生产大模型,以及豆包通用模型Pro的性能升级和成本降低,标志着AI应用的新一轮繁荣。这些更新不仅在多项测评中取得了优异成绩,还推动了AI技术的商业化进程。

随着人工智能产业的迅猛发展,AI大模型的性能提升日益依赖于强大的算力支持。据观察,AI模型的训练计算量正呈指数级增长,这一趋势直接推动了全球范围内AI基础设施建设的加速。预计在未来几年内,全球人工智能的资本开支将显著增长,特别是生成式人工智能领域的投资增速将更为迅猛。

在国内市场,众多厂商纷纷加大对AI Agent等应用的投入,以抢占市场先机。这一趋势进一步推动了AI算力服务器的需求增长。华为等科技巨头在算力基础设施研发方面持续加大投入,预计其服务器出货量将迎来大幅增长。与此同时,液冷技术因其在散热和节能方面的显著优势,正逐渐成为数据中心建设的主流趋势。据预测,中国液冷数据中心市场规模将在未来几年内实现快速增长。

在硬件层面,Nvidia推出的H200芯片在存储性能上实现了显著提升,为全球AI计算提供了更为强大的硬件支持。然而,国产AI芯片与国际顶尖水平仍存在一定差距。在当前美国出口管制的背景下,国产芯片的需求变得更加迫切。为了提升算力效率,高效传输架构的需求也日益凸显。叶脊网络架构的出现,进一步增加了光模块的需求,推动了全球光模块市场规模的持续增长。

值得注意的是,国产光模块厂商在高端领域已经展现出了出色的竞争力。随着AI技术的不断发展和应用领域的持续拓展,国产厂商有望在全球市场中占据更加重要的位置。