在国产人工智能领域,一场技术革命正在悄然上演。就在两个月前,国产大模型在考研数学题上的表现初露锋芒,而今,月之暗面团队在春节前夕再次扔出了一颗震撼业界的“重磅炸弹”——K1.5多模态模型。

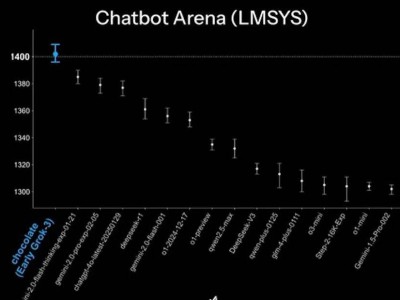

这款模型不仅在文字和视觉两大领域实现了卓越表现,更被业界认为已经媲美OpenAI的满血版o1(Full Version)模型。消息一出,全球范围内的网友迅速反响热烈,从日本到美国,再到阿拉伯国家,无不惊叹于Kimi模型在推理能力和多模态技术上的飞速进步。

发布时间上,虽然DeepSeek-R1的推出略早于K1.5,但从模态多样性来看,K1.5无疑是OpenAI之外,唯一实现o1正式版多模态推理的大模型。这一成就,无疑为中国AI事业的发展注入了强劲动力。

在性能测试方面,Kimi k1.5的表现同样令人瞩目。在short-CoT模式下,K1.5已经大幅超越了全球范围内短思考SOTA模型GPT-4o和Claude 3.5 Sonnet的水平,领先度高达550%。而在long-CoT模式下,Kimi k1.5的数学、代码、多模态推理能力,也足以与OpenAI的o1满血版相媲美。

值得注意的是,月之暗面团队此次还首次发布了训练报告《Kimi k1.5:借助大语言模型实现强化学习的Scaling》。这一报告不仅展示了Kimi k1.5的技术细节,更彰显了中国AI厂商在技术创新上的不懈追求。

回顾过去几个月,月之暗面团队的技术成果可谓层出不穷。从k0-math数学模型的发布,到k1视觉思考模型的推出,再到K系列强化学习模型的升级,每一步都凝聚着团队的智慧和汗水。而此次K1.5的发布,更是将中国AI技术推向了一个新的高度。

与国外,尤其是硅谷专业人士的反应相比,国内厂商和用户的沸腾或许更能体现K1.5在业界的影响力。面对月之暗面和Deepseek的最新推理模型成果,众多海外AI大V表达了极大的兴趣和期待。英伟达大佬Jim Fan更是发推感叹,技术的共享和开放对于AI行业的发展至关重要。

从技术层面来看,K1.5的领先并非偶然。月之暗面团队在训练方案上进行了大胆创新,提出了“Long2Short”训练方案。该方案通过长上下文scaling和改进的策略优化,将原本“长模型”的成果和参数与小而高效的“短模型”进行合并,再针对短模型进行额外的强化学习微调。这一创新不仅提高了训练效率,更在保留长模型推理能力的前提下,有效释放了短模型的高效推理和部署优势。

K1.5在测试阶段也采用了多种优化策略,如最短拒绝采样和DPO等,以在有限的测试token预算下,最大程度提升模型性能。这些创新举措,无疑为K1.5的卓越表现奠定了坚实基础。

如今,中国AI厂商在技术创新上的步伐已经今非昔比。从Kimi的后来居上,到更多国产大模型的崛起,中国AI行业正在逐渐缩小与国际大厂的差距。未来,随着技术的不断进步和创新,中国AI事业必将迎来更加辉煌的明天。

月之暗面团队并未止步于此。他们表示,将继续沿着既定路线图,加速升级K系列强化学习模型,带来更多模态、更多领域的能力和更强的通用能力。这一消息,无疑为业界注入了更多期待和信心。

随着K1.5的发布和更多国产大模型的崛起,中国AI行业正迎来前所未有的发展机遇。我们有理由相信,在未来的日子里,中国AI事业必将书写出更加辉煌的篇章。